― Impact, Governance, Safety, Power, Sovereignty

최근 몇 년 사이 국제기구와 연구기관에서 발표되는 AI 관련 보고서는 당연한 얘기지만, 엄청나게 늘어나고 있습니다. 처음에는 각각의 보고서가 서로 다른 주제를 다뤘습니다. 어떤 보고서는 AI의 사회적 영향에 집중하고, 어떤 보고서는 산업 경쟁력을 강조하며, 또 다른 보고서는 AI의 위험과 규제 문제를 얘기했습니다.

그런데, 이 보고서들을 쭉 보다보면 일정한 구조가 드러납니다. 서로 다른 기관들이 서로 다른 언어로 이야기하고 있지만, 실제로는 몇 가지 공통된 질문을 중심으로 논의가 전개되고 있습니다.

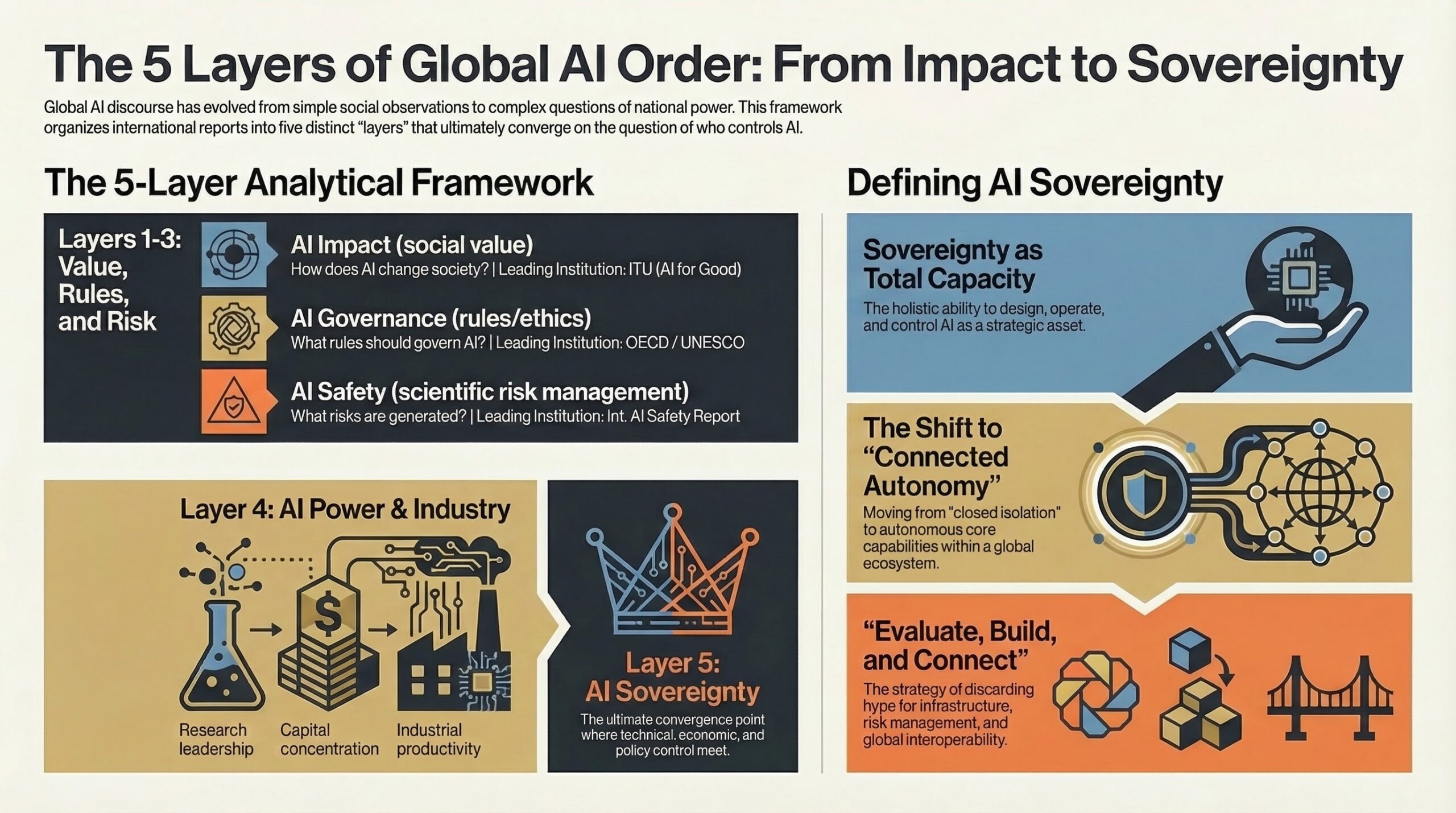

현재 국제기구나 국제 연구기관의 AI 담론을 구조적으로 정리하면 다음과 같은 5개 레이어로 설명할 수 있습니다.

- AI Impact

- AI Governance

- AI Safety

- AI Power

- AI Sovereignty

이 5개의 레이어는 AI 기술이 사회에 등장한 이후 국제사회가 어떤 질문을 던지고 있는지를 보여주는 일종의 분석 틀이라고 할 수 있습니다.

1. AI Impact

AI는 사회를 어떻게 변화시키고 있는가

첫 번째 레이어는 AI의 사회적 영향입니다.

이 레이어에서 가장 중요한 질문은

“AI는 실제로 사회를 더 나은 방향으로 변화시키고 있는가”

이 문제를 가장 직접적으로 다루는 국제 보고서 가운데 하나가 ITU 가 발표한 AI for Good Impact Report입니다. 이 보고서는 AI 기술이 교육, 의료, 환경, 농업, 재난 대응 등 다양한 영역에서 어떻게 활용되고 있는지를 분석하고 있습니다.

보고서가 강조하는 핵심 메시지는 AI는 단순한 기술 혁신이 아니라 사회문제를 해결하는 중요한 도구가 될 수 있다는 것입니다. 저도 항상 강조하는게 AI 라는 너무큰 변혁이 사회에 자리잡기 위해서는 결국 사람들의 수용성, 그러기 위해서는 사회문제 해결이 가장 우선시 되어야 한다는 점입니다.

예를 들어 AI는 의료 영상 분석을 통해 진단 정확도를 높일 수 있으며, 기후 데이터를 분석하여 환경 변화에 대한 대응 능력을 향상시킬 수 있고, 또한 농업 생산성을 높이거나 재난 대응 체계를 개선하는 데에도 활용될 수 있습니다. 우리나라의 경우로 보면 저출산고령화 문제에도 기여할 수 있고, 지역불균형, 난임, 구급차 뺑뺑이 등 다양한 사회적 난제에 기여할 수 있을 것입니다.

이와 같은 관점에서 보면 AI는 더 이상 단순한 기술 경쟁의 대상이 아니라 사회적 가치와 공공 문제 해결의 수단으로 등장합니다. 국제기구 보고서에서 “inclusive AI”, “responsible AI”, “sustainable development” 같은 개념이 반복적으로 등장하는 이유도 여기에 있다고 봅니다. 즉 이 레이어에서 AI는 기술 문제가 아니라 사회적 영향과 공공 가치의 문제로 이해됩니다.

2. AI Governance

AI는 어떤 규칙 아래 움직여야 하는가

두 번째 레이어에서는 질문이 조금 달라집니다.

“AI는 어떤 규칙과 제도 아래 운영되어야 하는가”

이 문제를 가장 적극적으로 다루는 기관이 OECD와 UNESCO입니다. OECD는 2019년 채택된 OECD AI Principles를 통해 ‘신뢰 가능한 AI(Trustworthy AI)’라는 개념을 제시했 왔습니다. 이 원칙은 AI 기술이 인간 중심 가치, 투명성, 책임성, 안전성 등을 기반으로 개발되고 활용되어야 한다는 점을 강조합니다.

최근에는 OECD.AI Observatory와 OECD.AI Index를 통해 국가별 AI 정책과 생태계를 분석하고 있는데요, AI 정책을 단순한 선언이나 윤리 원칙에 머무르게 하지 않고, 측정 가능한 정책 프레임워크로 발전시키려는 시도라고 할 수 있습니다.

UNESCO 역시 Recommendation on the Ethics of Artificial Intelligence를 통해 인간 중심 AI(human-centered AI)를 강조하고 있습니다. 이 문서는 AI 기술이 인간의 권리와 존엄성을 존중하는 방식으로 개발되어야 한다는 점을 강조하며, 각국 정부가 윤리적 거버넌스를 구축해야 한다고 제안합니다. (얼마전 고대에서 열린 UNESCO 세미나에 참석한 적이 있는데요, 역시 정책 프레임워크 개발을 위한 세미나 였습니다.)

이 레이어에서 AI는 더 이상 기술 자체의 문제가 아니라 정책, 제도, 규칙의 문제로 등장합니다.

3. AI Safety

AI는 어떤 위험을 만들어내는가

세 번째 레이어에서는 또 다른 질문이 등장합니다.

“AI 기술이 어떤 위험을 만들어낼 수 있는가”

이 문제를 대표적으로 다룬 리포트가 International AI Safety Report 2026입니다. 이 리포트는 범용 AI 시스템이 현재 어떤 능력을 가지고 있는지, 어떤 위험을 만들어낼 수 있는지, 그리고 그러한 위험을 어떻게 관리할 수 있는지를 분석하고 있습니다.

보고서는 특히 다음과 같은 위험을 강조합니다.

- 악의적 사용 가능성

- 허위 정보 생성

- 사이버 공격

- 생물학적 위험

- 사회적 혼란

이 보고서에서 중요한 것은 AI 위험 논의가 단순한 윤리적 우려를 넘어 과학적 분석과 정책 대응의 영역으로 이동하고 있다는 점입니다. 즉,AI 안전 문제가 더 이상 기술적 논쟁이 아니라 국가 안보와 국제 협력의 정책 의제가 된것입니다. AI 기술의 능력이 빠르게 확장될수록 위험 관리 역시 중요한 정책 과제가 됩니다. 따라서 이 레이어에서 AI는 기술 문제가 아니라 안전과 위험 관리의 문제로 이해됩니다.

4. AI Power

AI는 어떤 산업 구조를 만들어내는가

네 번째 레이어에서는 AI가 경제와 산업 구조를 어떻게 변화시키는지에 대한 논의가 등장합니다. 이 문제를 가장 잘 보여주는 보고서가 Stanford AI Index와 World Economic Forum의 AI 보고서입니다.

Stanford AI Index는 AI 연구 논문, 투자 규모, 인재 분포, 기업 활동 등을 분석하여 AI 기술 발전의 구조를 데이터로 보여줍니다. 이 보고서는 어떤 국가가 AI 연구를 주도하고 있는지, 어디에 자본이 집중되고 있는지, AI 산업이 어떻게 성장하고 있는지를 파악하는 데 중요한 자료로 활용됩니다.

World Economic Forum의 보고서는 AI가 기업과 산업 구조를 어떻게 변화시키고 있는지를 분석합니다. 특히 기업 조직이 AI 기술을 도입하면서 생산성과 경쟁력을 어떻게 높일 수 있는지에 대한 전략을 제시합니다.

이 레이어에서 AI는 기술 문제가 아니라 경제 권력과 산업 경쟁력의 문제로 등장합니다. 여기서 한 가지 중요한 변화가 나타납니다. 최근 국제 보고서들을 함께 읽어보면 AI 경쟁이 단순한 산업 경쟁을 넘어 AI 인프라와 국가 역량을 둘러싼 경쟁으로 이동하고 있다는 점입니다.

5. AI Sovereignty

모든 질문이 결국 향하는 지점

이 5개의 레이어의 논의를 따라가다 보면 결국 하나의 질문으로 수렴하게 됩니다.

누가 AI를 통제할 것인가 하는 문제입니다.

바로 AI Sovereignty입니다. 우리가 주구창창 외쳐온 바로 그 <소버린 AI> 입니다.

흥미로운 점은 국제기관들이 이 개념을 동일한 용어로 사용하지 않는다는 것입니다. 대신 각 기관은 서로 다른 정책 언어를 사용하여 같은 문제를 설명합니다.

OECD는 이를 신뢰 가능한 AI 생태계(trusted AI ecosystem)라는 관점에서 설명합니다.

World Economic Forum은 AI 경쟁력(AI competitiveness)이라는 산업 전략의 언어로 접근합니다.

UNESCO는 인간 중심 AI(human-centered AI)라는 윤리적 프레임을 강조합니다.

Stanford AI Index는 이를 직접 정의하지는 않지만 국가 AI 역량(national AI capability)을 데이터로 보여줍니다.

표현은 다르지만 결국 같은 질문으로 이어집니다.

- 누가 AI 기술을 통제하는가.

- 누가 AI를 통해 경제적 가치를 창출하는가.-

- 누가 AI의 위험을 관리할 수 있는가.

이제 다들 아시는 것처럼, AI 경쟁은 이제 단순한 기술 경쟁이 아닙니다. 오늘날 AI 경쟁은 기술 역량, 산업 구조, 정책 거버넌스, 위험 관리가 동시에 작동하는 문명적 전환 수준의 경쟁이 되고 있습니다.

그리고 이러한 경쟁의 핵심 개념이 바로 AI Sovereignty입니다.

AI sovereignty는 단순히 자국 AI 모델을 개발하는 것을 의미하지 않죠. AI라는 새로운 기술 인프라이자 국가전략자산을 설계하고 운영하며 통제할 수 있는 국가의 총체적 역량을 의미하는 겁니다.

그런데 이 주권 개념은 오해되기 쉽습니다. 주권이라고 하면 곧바로 폐쇄성이나 국산화 집착으로 오독되곤 합니다. 그러나 2026년 국제 보고서들의 흐름은 오히려 그 반대에 가깝습니다. 국제 협력, 공통 평가, 상호운용, 책임 있는 거버넌스가 반복적으로 강조됩니다.

즉 오늘의 AI 주권은 “혼자 다 만들자”가 아니라, 핵심 기반과 평가·조정 능력은 자율적으로 갖추되, 글로벌 생태계와 연결되는 방식에 더 가깝습니다. 제가 밀고 있지만, 아직 범용적으로 퍼지지는 않은(?) Connected autonomy, 연결된 자율성과 잘 맞는 지점이 바로 여기입니다.

국제 질서도 사실상 그 방향으로 움직이고 있습니다. 순혈주의적 AI는 멋있어 보일 수 있지만, 실제 세계는 공급망·클라우드·오픈소스·모델 생태계가 얽힌 거대한 혼종 시스템입니다. 순수혈통을 외치는 순간 현실이 비웃습니다

그리고 바로 그 지점에서, 앞으로의 AI 전략은 두 개의 허세를 버려야 한다고 봅니다.

하나는 “우리가 세계 최고 모델만 만들면 다 해결된다”는 허세이고,

다른 하나는 “남 좋은 모델 가져다 붙이면 곧바로 혁신된다”는 허세입니다.

현실은 그 중간 어딘가, 더 정확히는 훨씬 더 복합적인 곳에 있습니다.

국제 보고서들이 보여주는 답은 제가 볼때 이렇습니다.

“평가하라, 기반을 깔아라, 조직을 바꿔라, 위험을 관리하라, 그리고 연결된 자율성을 확보하라.”

<주요 참고 보고서>

- International AI Safety Report 2026

https://internationalaisafetyreport.org/publication/international-ai-safety-report-2026 - ITU & Deloitte, AI for Good Impact Report 2025 (2nd Edition)

https://aiforgood.itu.int/reports_publications/ai-for-good-impact-report-2025-2nd-edition/ - OECD, Due Diligence Guidance for Responsible AI (2026)

https://www.oecd.org/en/publications/oecd-due-diligence-guidance-for-responsible-ai_41671712-en.html - Stanford HAI, AI Index Report

https://hai.stanford.edu/ai-index - UNESCO, AI Readiness Assessment Methodology (RAM)

https://www.unesco.org/en/artificial-intelligence - World Bank, World Development Report 2026

https://www.worldbank.org/en/publication/wdr2026