Kimi (문샷AI)가 2026년 3월 16일 발표한 따끈따끈한 논문입니다.<Attention Residuals (AttnRes)>는 LLM의 표준인 PreNorm 잔차 연결(Residual Connection) 방식이 가진 근본적인 한계를 해결하기 위해 제안된 기술입니다. (잔차 연결은 레이어의 입력을 출력에 그대로 더해 정보와 그래디언트가 끊기지 않고 깊게 흐르도록 만드는 같은 연결 방식)

기존 방식은 Layer가 깊어질수록 이전 모든 레이어의 출력을 단순히 똑같은 비중(고정된 가중치)으로 더해나가는 방식을 취했기 때문에,

레이어가 점점 깊어질수록 앞쪽 레이어에서 생성된 정보가 뒤섞이고 희석되어, 정작 중요한 초기 정보를 선택적으로 불러오지 못하거나 은닉 상태의 크기가 무분별하게 커져 학습이 불안정해지는 ‘PreNorm 희석’ 문제가 발생해 왔습니다.

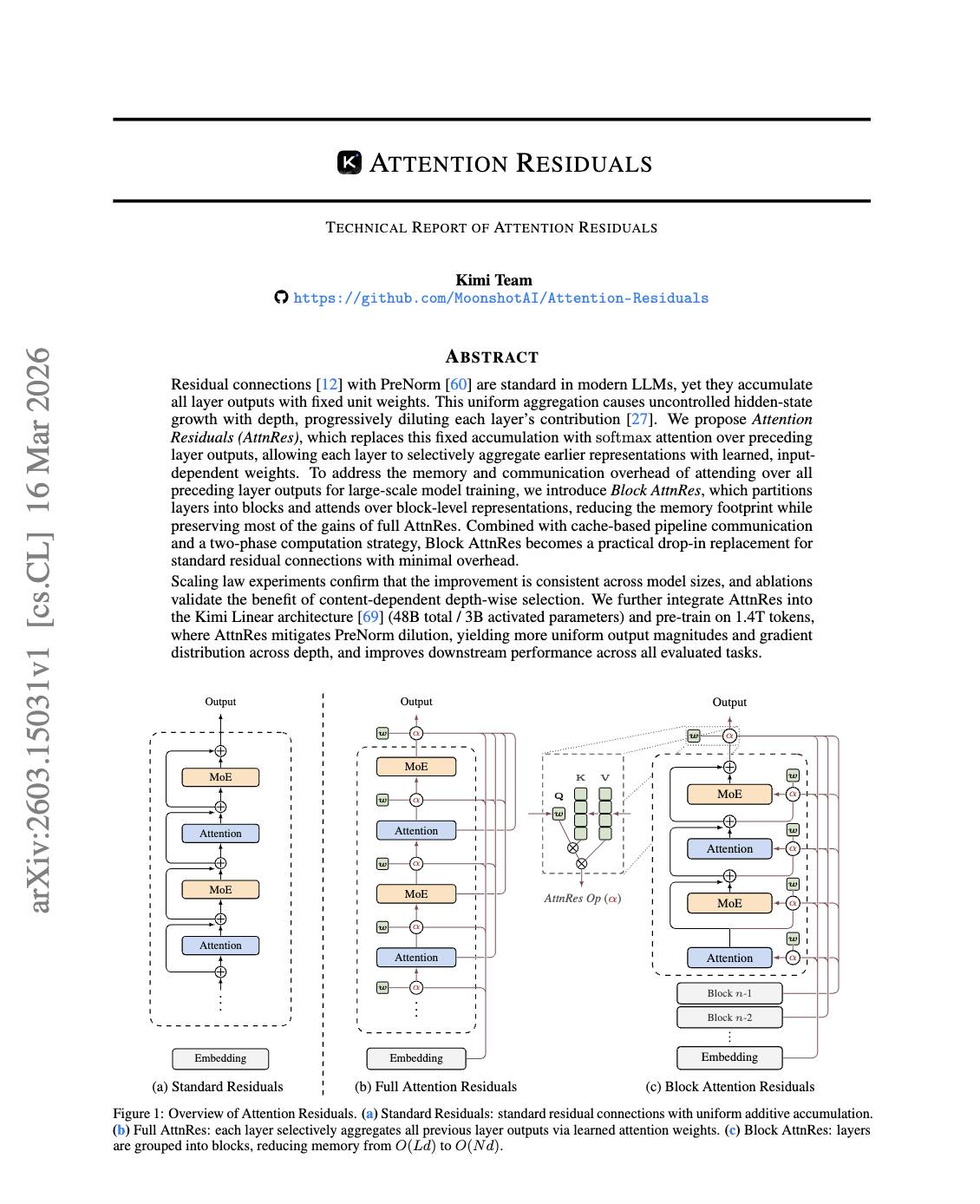

Kimi 는 이러한 문제를 해결하기 위해 Attention 메커니즘을 레이어와 레이어 사이의 연결(깊이 차원)에 도입했습니다. AttnRes는 각 층마다 학습 가능한 의사 쿼리를 두어, 이전 레이어들의 출력물 중 현재 층의 연산에 가장 필요한 정보가 무엇인지 스스로 판단하여 소프트맥스 가중치로 선택적 취합하게 합니다. (소프트맥스 어텐션은 수많은 과거 정보 중 현재 가장 필요한 데이터에만 확률적으로 가중치를 몰아주어 선택적으로 추출하는 메커니즘입니다.)

이렇게 하면 레이어 사이의 정보를 전달할 때 단순히 앞사람의 말을 보태기만 하는 것이 아니라, 이전 기록 전체를 훑어보고 필요한 부분만 발췌해서 쓰게 된다고 합니다.

특히 LLM에 실질적으로 적용하기 위해 Block AttnRes라는 효율적인 구조를 함께 제안했는데요, 모든 레이어를 일일이 어텐션으로 연결하면 메모리와 통신 비용이 너무 커지기 때문에, 여러 층을 하나의 ‘블록’으로 묶고 블록 단위로 요약된 정보들 사이에서 어텐션을 수행하도록 설계한 것입니다.

실험 결과, 단 8개 정도의 블록만 사용하더라도 모든 층을 연결했을 때의 성능 이점을 대부분 유지하면서 메모리 사용량은 획기적으로 줄일 수 있음을 증명했습니다.

이 기술을 적용한 결과, 모델은 동일한 성능을 내는 데 있어 기존 대비 약 1.25배 적은 컴퓨팅 자원만 사용해도 될 만큼 효율이 높아졌고, 벤치마크 테스트에서도 MMLU와 같은 지식 위주 평가뿐만 아니라, 특히 GPQA나 Minerva Math, HumanEval과 같이 여러 단계의 복합적인 추론과 코드 생성이 필요한 작업에서 큰 성능 향상을 보였다고 합니다. 저기 딥한 차원에 있는 레이어에서도 초기 정보를 손실 없이 가져와 활용할 수 있게 된 덕분으로 분석됩니다.

———

그러니까, 정리해보자면, 기존 잔차 연결은 모든 과거 정보를 100% 다 가져오는 Dense 방식인 반면, AttnRes는 소프트맥스(Softmax)를 통해 특정 정보에만 집중하는 겁니다. 이 논문에서 제안한 모델(Kimi Linear) 자체가 희소 활성화(Sparsely Activated) 모델인 MoE 구조를 기반으로 하는걸 보면,

기존 MoE가 가로 차원에서 수많은 전문가 중 일부만 골라 쓰는 희소 활성화 방식이라면, Attention Residuals 는 세로, 그러니까 깊이 차원에서 이전 레이어들의 수많은 데이터 중 필요한 것만 소프트맥스 어텐션으로 정밀하게 추출하여 활용하는 기술이라서, 결과적으로 이 두 기술의 결합은 가로와 세로 모든 방향에서 불필요한 연산을 배제하고 핵심 정보에만 집중하는 sparse 모델의 효율성을 더더 극대화하는 중요한 지점으로 보이네요.

결국, 계속 모델은 sparse 하게 효율적으로 진화를….

* p.s. : 혹시 제 생각이 틀리면 지적을….^^