LLM은 기본적으로 질문이 입력되면 답변을 생성하고 세션이 종료됨과 동시에 모든 처리 정보를 초기화하는 완전한 무상태성(Stateless) 시스템입니다. 물론 ‘메모리’ 기능으로 과거의 대화 기록이나 사용자 정보를 외부 데이터베이스에 텍스트로 저장해 두었다가, 새로운 대화가 시작될 때 시스템 프롬프트에 이를 덧붙여 주입(In-Context Memory)함으로써 사용자를 기억하고 맥락을 유지하는 것처럼 작동합니다.

하지만 이 방식은 외부에서 기억을 끌어와 읽어낼 뿐, AI의 지능을 결정하는 모델 본체의 파라미터는 전혀 변하지 않는 Frozen상태에 머물러 있습니다.

이보다 진일보한 기존 에이전트 시스템은 도구 실행 결과, GUI 상태 변화, 에러 로그 등을 단기적인 작업 세션 내에 누적하며 맥락 수준의 상태(Context-Level Stateful)를 유지합니다.

로컬 기반 OpenClaw 는 좀더 나아가 개인 기기에서 사용자의 선호도와 파일 접근 기록 등을 영구적인 로컬 DB에 보관하여 비교적 장기적인 상태를 유지합니다.

하지만 기본적으로 상호작용 후 발생하는 피드백이나 에러 로그를 단순히 다음 행동을 결정하기 위한 일회성 입력값으로만 취급하고 폐기합니다.

저장된 과거 데이터를 프롬프트로 불러올 뿐, 에이전트가 직접 경험한 상호작용 결과를 바탕으로 모델 본체의 가중치가 실시간 재학습되거나 진화하지 않기 때문에 결국 동일한 환경에서 같은 실수를 반복하는 근본적인 한계가 있습니다.

# OpenClaw-RL : 파라미터 진화를 위한 하이브리드 최적화와 비동기 인프라

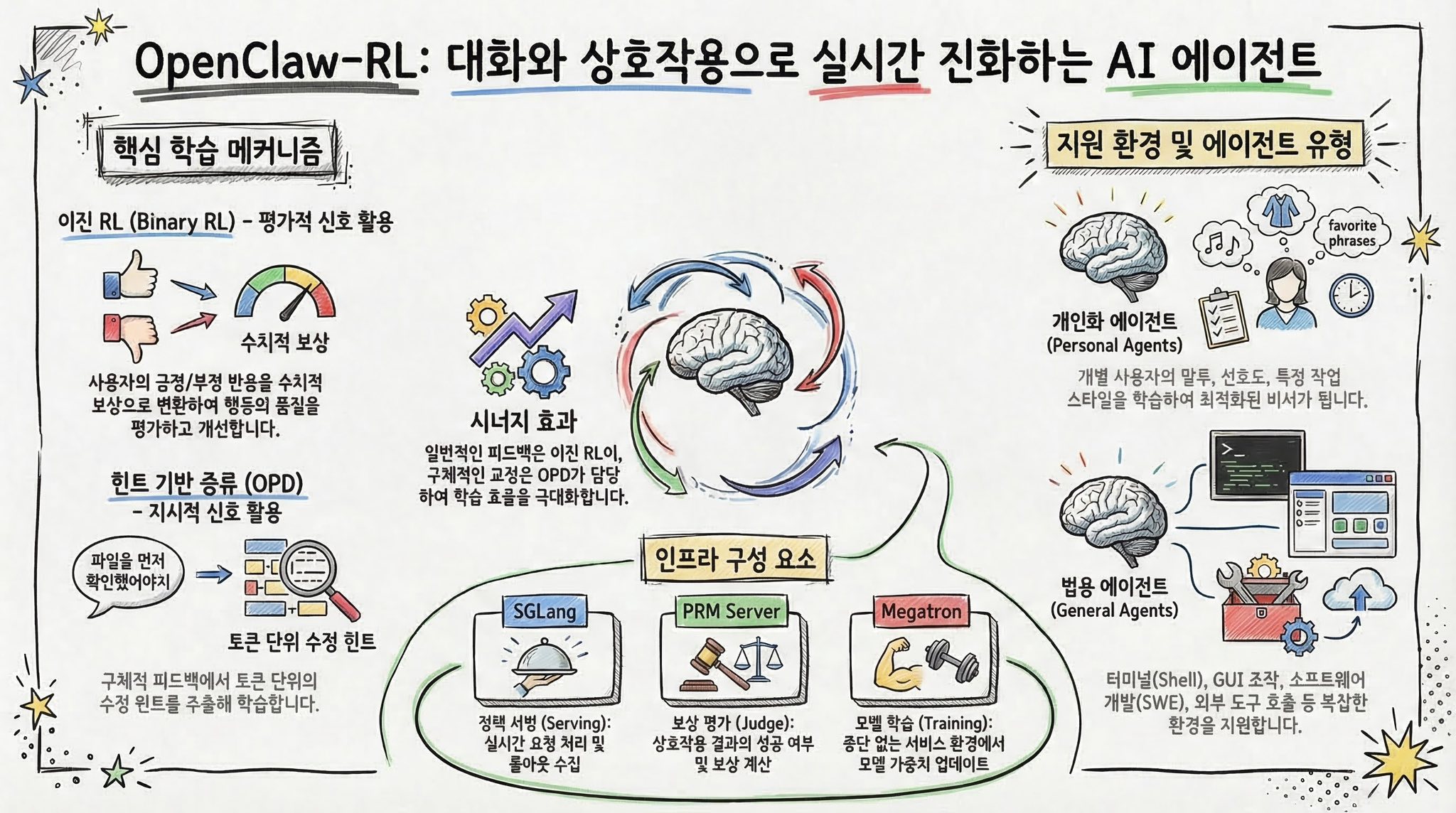

프린스턴대 연구진이 3월 10일 발표한 OpenClaw-RL은 프롬프트 조작의 한계를 넘어, 에이전트가 현장에서 수집하는 다음 상태 신호(next-state signals)를 실시간 훈련 자원으로 전환하여 파라미터 자체를 직접 업데이트하는 프레임워크입니다.

에이전트의 행동 직후 발생하는 반응에는 해당 행동이 얼마나 성공적이었는지 평가하는 ‘평가적 신호’와, 구체적으로 어떻게 수정되어야 하는지 지시하는 ‘지시적 신호’가 혼재되어 있습니다.이 두 가지 신호를 모두 파라미터에 흡수시키기 위해 상호 보완적인 두 가지 최적화 기법을 활용했습니다.

첫째, 평가적 신호를 처리하는 ‘이진 강화학습(Binary RL)’입니다. 사용자가 답변에 불만족하여 재질문을 하거나 터미널에서 에러 코드가 반환되면, 다수의 프로세스 보상 모델(PRM)이 이 다음 상태를 분석하여 이전 행동에 대해 +1(성공), -1(실패), 0(중립)의 스칼라 보상을 부여하는 다수결 투표(Majority vote)를 진행합니다.

이 방식은 긴 단계가 필요한 작업에서 최종 결과가 나오기 전이라도, 각 행동 단계마다 촘촘하게 프로세스 보상을 제공하여 PPO 알고리즘 기반의 정책 그래디언트 업데이트를 가능하게 한다고 합니다.

둘째, 지시적 신호를 처리하는 ‘힌트 기반 on policy 디스틸레이션(Hindsight-Guided OPD)’입니다.

예를 들어, “그 라이브러리 말고 다른 걸 써야지”처럼 사용자가 명시적인 교정을 요구할 때, 단순한 스칼라 보상(-1점)만으로는 뭘 어떻게 고쳐야 할지 모델에게 알려줄 수 없습니다.

OPD 기법은 보상 판독기가 사용자의 피드백에서 1~3문장 분량의 구체적인 ‘텍스트 힌트’를 추출해냅니다. 이후 원래의 프롬프트에 이 힌트를 결합하여 Enhanced teacher context 을 생성합니다.

에이전트는 이 힌트를 미리 알고 답변했을 때의 이상적인 토큰 확률(Teacher)과 힌트를 모른 채 대답했던 실제 토큰 확률(Student) 간의 Log-probability gap를 계산합니다. 이를 통해 긍정적인 토큰의 확률은 높이고 부정적인 토큰의 확률은 억제하는, 토큰 단위의 정밀한 Directional advantage 를 파라미터에 직접 새겨 넣습니다.

구체적 예를 들어보면, 에이전트가 데이터 분석 코드를 작성하며 윈도우 환경에 없는 리눅스 전용 라이브러리를 임포트하여 오류가 발생했을 때, (윈도우 환경에서 openclaw 랑 antigravity 쓰다가 이거로 엄청 고생했습니다 ㅠㅠ)

“윈도우 환경이니 해당 라이브러리 대신 표준 라이브러리를 사용해”라고 피드백하면, Hindsight-Guided OPD는 윈도우 환경 준수 및 대체 라이브러리 사용이라는 구체적인 텍스트 힌트를 추출합니다.

시스템은 원래의 지시문에 이 힌트를 미리 포함시켜 정답 코드를 알고 있는 ‘교사 상태’를 가상으로 설정한 뒤, 리눅스 라이브러리를 호출했던 ‘실제 답변’과의 토큰 확률 격차를 계산하며, 오류를 유발한 특정 코드 토큰의 확률은 낮추고 윈도우 표준 라이브러리 토큰의 선택 확률은 대폭 높이는 Directional advantage를 수행합니다.

결과적으로 이 과정은 단순히 코드를 고쳐 쓰는 수준을 넘어, 에이전트의 신경망 가중치 자체에 윈도우 환경에서의 라이브러리 선택 로직을 물리적으로 각인시킴으로써 이후 유사한 작업 시 추가 지정 없이도 처음부터 환경에 맞는 코드를 생성하는 진정한 의미의 Stateful 에이전트로 진화하게 만드는거죠

이러한 복잡한 실시간 파라미터 업데이트는 Slime 프레임워크 기반의 ‘완전 비동기식 4중 아키텍처’를 통해 사용자 경험 저하 없이 구현됩니다. 정책 서빙(SGLang), 환경 서버(HTTP/API), 보상 판독(PRM Server), 그리고 정책 훈련(Megatron)이라는 네 가지 핵심 컴포넌트가 서로의 연산을 대기하지 않고 독립적으로 작동합니다. 서빙 모델이 사용자와 지연 없이 상호작용하는 동안, 훈련 엔진은 백그라운드에서 조용히 파라미터 연산을 마치고 가중치 업데이트를 수행하므로 서비스 중단이 전혀 발생하지 않습니다. (물론 당연히 오픈소스 모델로..)

연구진이 수많은 프레임워크 중 OpenClaw를 기반으로 삼은 이유는, 이 시스템이 단순히 대화만 나누는 챗봇을 넘어 사용자의 로컬 환경이 직접 맞닿아 작동하는 실행 중심 아키텍처를 갖추고 있었기 때문으로 보입니다. 파라미터 수준의 자가 진화를 실증하기 위해서는 에이전트가 환경과 상호작용하며 겪는 ‘실제 에러’와 ‘현장 피드백’이 필수적인데, OpenClaw는 이러한 에이전트 중심 데이터가 발생하는 현장 그 자체를 플랫폼 내에 이미 확보하고 있었습니다.

결과적으로 Action과 Feedback, 그리고 파라미터 업데이트(Learning)가 하나의 현장 루프 안에서 완결되는 ‘실전형 자가 학습 인프라’를 증명하기 위해 OpenClaw를 전략적 거점으로 선택한 것이죠.

# 에이전트 중심 데이터(Agent-Centric Data)의 중요성과 진정한 Stateful AI로의 도약

이 프레임워크가 중요한건 사전에 사람이 레이블링하여 구축한 정적인 오프라인 데이터셋에 의존하던 기존 강화학습(RLHF, DPO 등)의 패러다임을 완전히 바꾼겁니다. 모델은 사용자와 대화하고 환경의 피드백을 받는 일상적인 상호작용 속에서 자생적으로 ‘에이전트 중심 데이터’를 끝없이 생성해냅니다. 기존 시스템에서는 프롬프트 창 안에서 단기적으로 소비되고 버려지던 이 생생한 상호작용 결과물 안에는 에이전트 스스로 행동을 채점할 수 있는 평가 정보와 모델을 수정할 수 있는 교정 지시가 들어있죠.

OpenClaw-RL은 이렇게 에이전트의 활동 반경 내에서 생성되는 밀착형 중심 데이터를 즉각적으로 흡수하여, 모델의 가중치를 영구적으로 변화시킵니다. 즉, 데이터의 주도권이 외부의 정제된 벤치마크 셋에서 에이전트 내부의 실질적인 상호작용 경험으로 이동한 것입니다. 외부 데이터의 단순한 텍스트 주입에 의존하여 ‘기억하는 척’하던 stateless 가, 자신의 행동과 실수, 사용자의 교정 경험을 파라미터라는 물리적 뇌 구조에 차곡차곡 누적시키는 진정한 의미의 상태 유지형(Parametric Stateful) AI로 도약하고 있는겁니다.

차세대 AI 플랫폼의 핵심 경쟁력은 바로 이 ‘에이전트 중심 데이터’를 현장에서 얼마나 빠르고 정밀하게 파라미터 진화의 동력으로 연결해 낼 수 있는지에 달려 있다고 생각합니다.