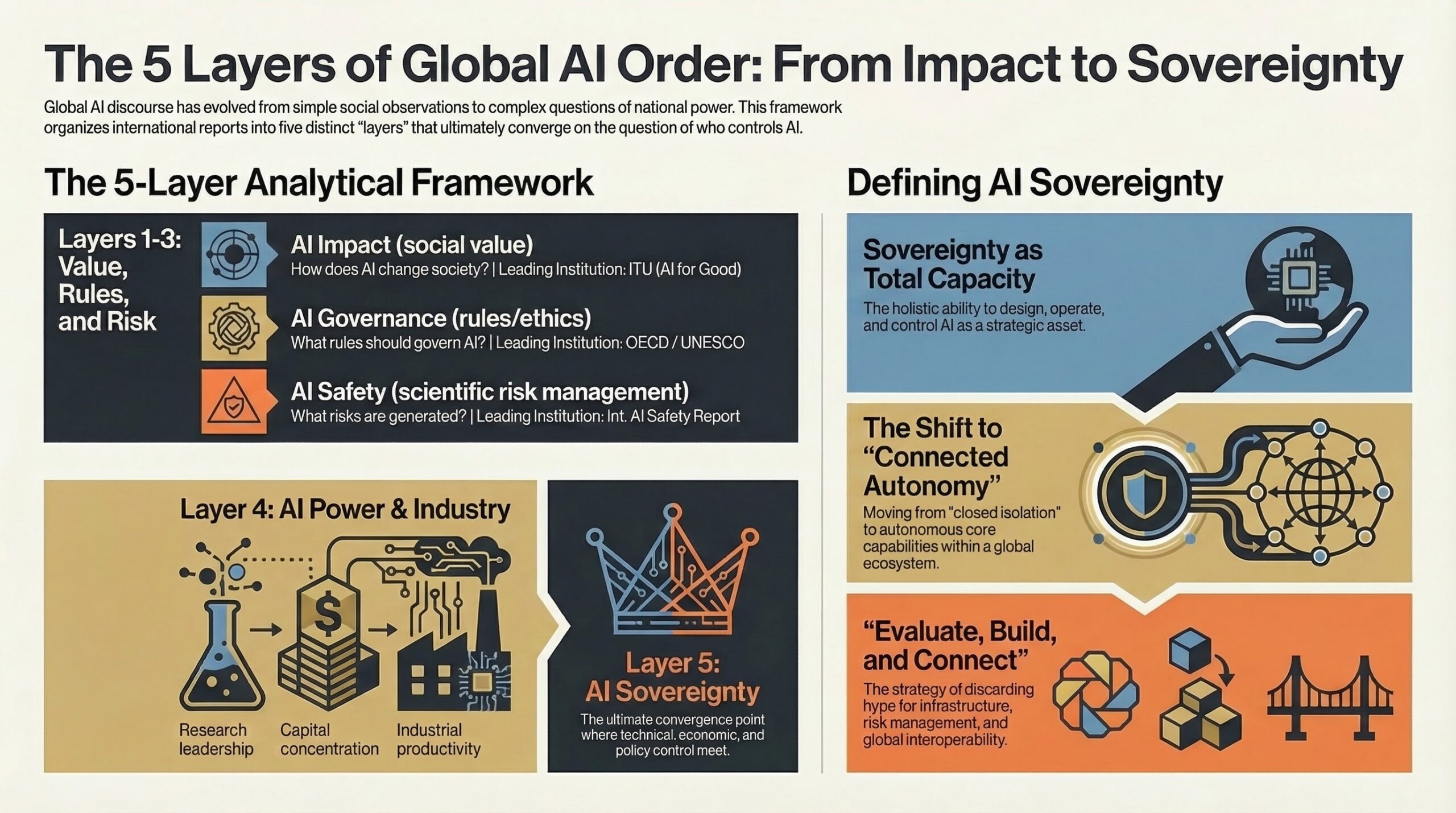

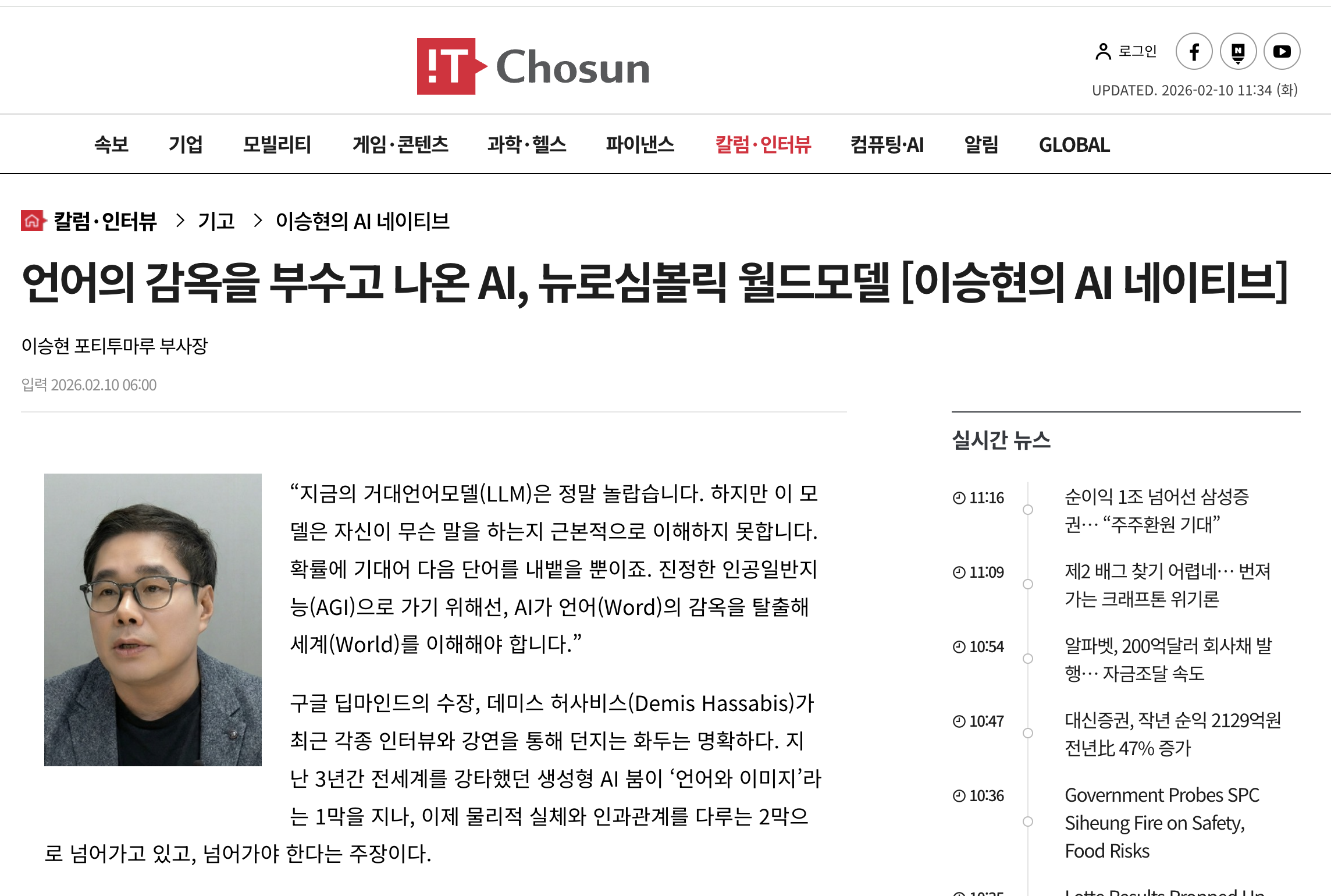

AI 국제질서의 구조

― Impact, Governance, Safety, Power, Sovereignty 최근 몇 년 사이 국제기구와 연구기관에서 발표되는 AI 관련 보고서는 당연한 얘기지만, 엄청나게 늘어나고 있습니다. 처음에는 각각의 보고서가 서로 다른 주제를 다뤘습니다. 어떤 보고서는 AI의 사회적 영향에 집중하고, 어떤 보고서는 산업 경쟁력을 강조하며, 또 다른 보고서는 AI의 위험과 규제 문제를 얘기했습니다. 그런데, 이 보고서들을 쭉 보다보면 일정한 구조가 드러납니다. … 더 읽기